StarRocks

更新时间: 2025-01-07 19:26:40

离线同步任务支持StarRocks数据源,支持该数据源的抽取(Reader)和导入(Writer),当前支持的版本为:1.19。

使用前提

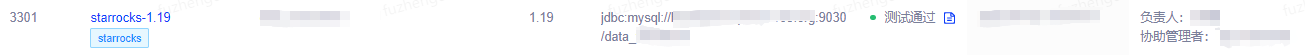

在使用之前需要在项目中心(新)完成StarRocks数据源的登记并测试通过。

数据源登记过程中,需要填写如下信息:

- 数据源名称:StarRocks数据源的名称

- 数据源标识:仅允许包含英文小写、数字、下划线,只允许英文小写开头,最大长度为64个字符。平台内唯一,保存数据源后数据标识不可修改

- 归属项目:由于元数据中心是项目组级别,因此此处支持选择项目组下的项目,默认为当前项目名称

- 负责人:默认为当前创建人员

- 协助管理员:同负责人,有该数据源的管理权限,包括编辑、设置“源系统账号映射”。可在安全中心为自己或其他人设置该数据源的使用权限

- 版本:1.19

- 数据源连接:根据jdbc:mysql://SeverIP:Port/Database格式进行填写

- fenodes:FE上的http server地址,填写格式host:port

- 用户名:填写访问数据源的用户名

- 密码:填写用户名所对应的密码

- 自定义属性:支持添加数据源的其它配置

|

唯一性校验规则:基于数据源连接+用户名进行校验。 |

数据源配置完成后,需点击测试连接按钮进行测试,测试通过后才可使用。

除了数据源需要准备之外,进行离线同步任务创建和数据源的使用都需要在安全中心-功能权限中添加相应的权限(可参考数据传输权限、元数据中心权限)。

StarRocks作为数据来源

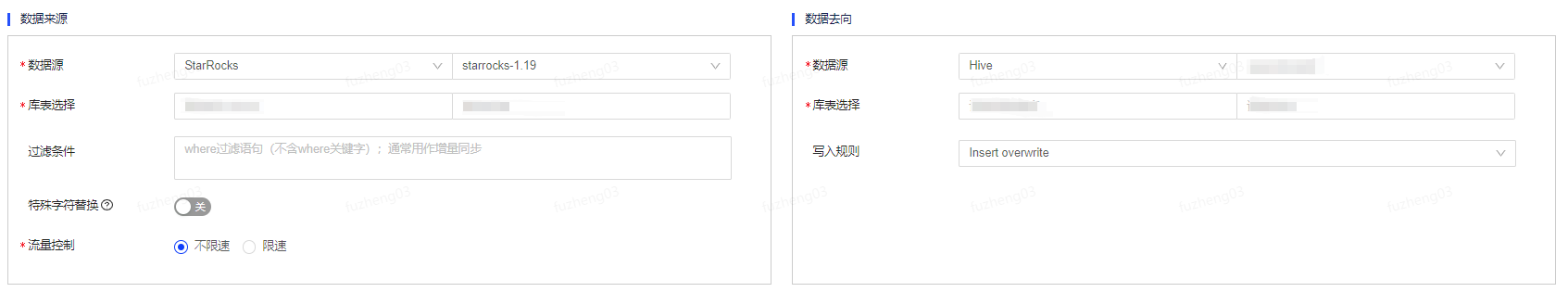

以StarRocks to Hive为例,在数据来源端选择StarRocks数据源类型及数据源名称,选择需要进行读取的schema和表。过滤条件支持填写where过滤语句(不含where关键字),通常用作增量同步,支持系统参数和参数组参数。特殊字符替换、流量控制根据实际情况进行填写。

StarRocks作为数据去向

当StarRocks作为数据去向时,需要配置如下:

- 数据源:选择StarRocks和已经登记的StarRocks数据源

- 库表选择:选择需要导入的schema和表

- PreSql:导入数据前执行的SQL语句,例如清除旧数据;目前向导模式仅允许执行五条SQL语句,多条SQL语句通过“;”分隔,最大长度为2000个字符

- PostSql:导入数据后执行的SQL语句,例如加上某一个时间戳;目前向导模式仅允许执行五条SQL语句,多条SQL语句通过“;”分隔,最大长度为2000个字符

- 导入方式:当前只支持stream load

- 导入间隔:默认为0ms,根据实际情况填写

- 写入规则:当前只支持Insert into(追加)

- 流量控制:默认不限速,支持手动配置,单位为条/s

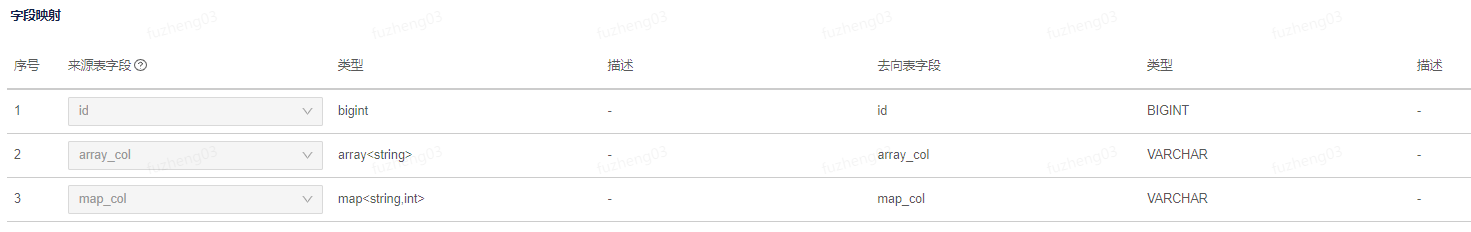

Hive to StarRocks场景支持复杂类型转换,当数据来源端字段类型为:map、array类型时,支持转为json写入去向端。

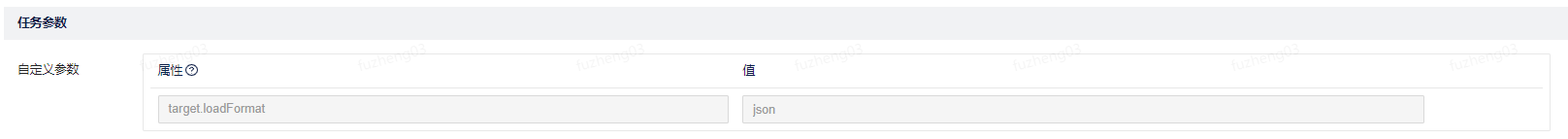

读取数据时,数据来源端字段类型为map、array时,默认转为json格式的字符串。写入数据时,stream load导入方式下支持使用csv或json的序列化格式写入数据,默认序列化格式为csv。如果需要用json格式,则需要在高级配置的任务参数中自定义参数target.loadFormat:json。